曾任職於美國國防部(United States Department of Defense,DoD)負責研發軍用高科技之行政機構——國防先進研究計畫署(Defense Advanced Research Projects Agency,DARPA),並擔任技術辦公室主任的John Launchbury博士,提出了「人工智慧三階段」(three waves of AI)[1]的觀點。而目前人工智慧的發展正處於第二階段,也就是所謂的「統計階段」(Statistical Learning),意即以大數據(big data)為基礎,發展機器學習(machine learning)與深度學習(deep learning)技術。

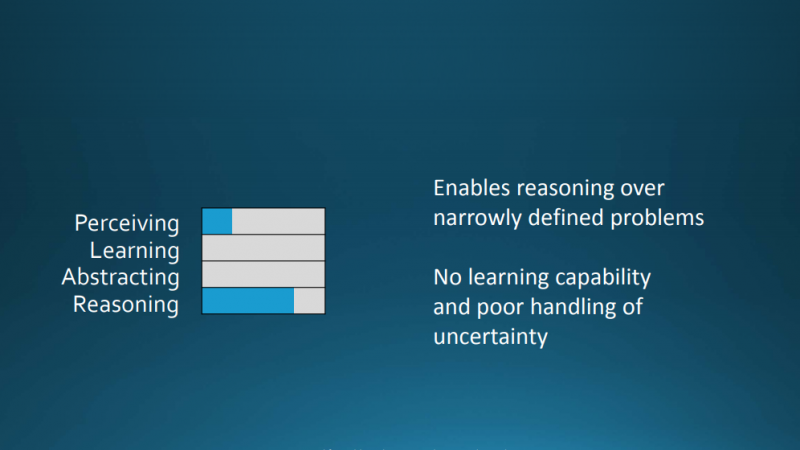

圖1:第一階段人工智慧發展特性

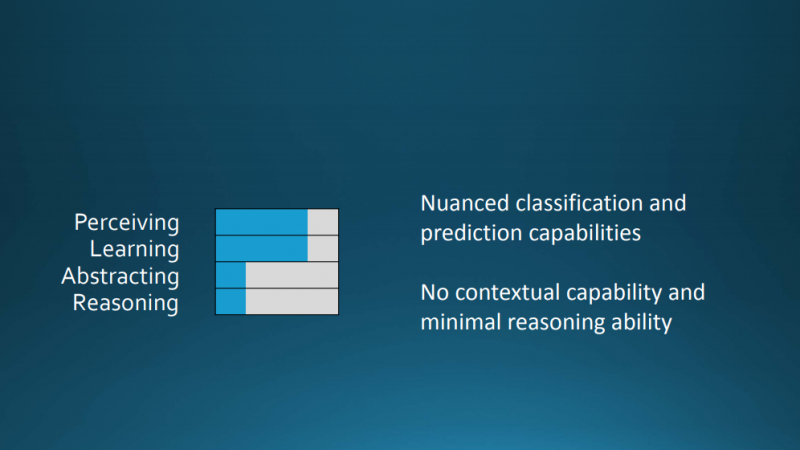

圖2:第二階段人工智慧發展特性

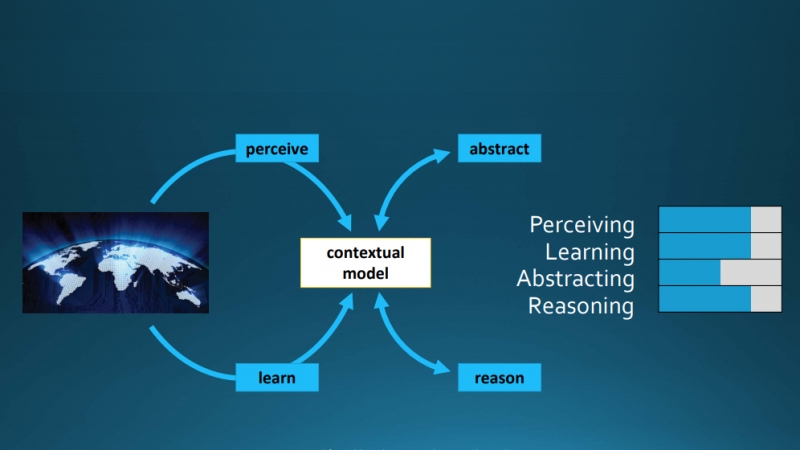

圖3:第三階段人工智慧發展特性

人工智慧的發展與問題

透過人工智慧技術,企業能輕易推估消費者的行為和偏好,進而更精準地提供產品和服務,然而人工智慧技術的相關爭議案例卻層出不窮。

正如Launchbury博士提及第二階段人工智慧的困境之一,就是偏頗的訓練數據(skewed training data)會造成人工智慧的適應不良(maladaptation),最知名的案例就是2016年微軟研究院與Bing團隊共同研發在Twitter平臺上推出的人工智慧聊天機器人,上架不到一天就被使用者灌輸資料教育成激進種族言論者[2],在各方爭議下黯然下架;另外一個案例是史丹佛大學(Stanford University) 2017年的一項研究[3],利用人工智慧來辨認出同性戀者,引發許多討論與爭議[4],因世界上尚有像是汶萊、伊朗等10個國家[5]的法律,仍將同性戀視為犯罪且可被處以死刑,人工智慧技術因而容易變成危險的工具,更遑論技術上的誤判(false positive)可能造成的冤案。

上述兩個案例觸及的都是人工智慧技術使用上會碰到的道德問題(ethic),如美國加州西部法學院知名科技法專家 James Cooper教授[6]在台北時報(Taipei Times)中撰文[7]指出,儘管不具有拘束力,但在2019上半年,各國已展開研擬人工智慧的道德準則,因為這些準則可以在不破壞各國產業政策的前提下,成為有利於處理人工智慧的方法。

在新科技產業中,要在資料隱私、網路安全問題與獲取商業戰略優勢的期望中取得平衡,是非常不容易的,這不僅是期望控制人工智慧的國家之間的競爭,同樣也是由誰來管制的競爭。

澳洲人工智慧倫理架構

2019年11月,澳洲的「工業、科學和技術部」(Minister for Industry, Science and Technology)Karen Andrews部長宣布[8]了澳洲政府的官方《人工智慧倫理架構》(AI Ethics Framework)[9],內容中最重要的就是8條讓企業和組織在設計、開發、整合或使用人工智慧時的自願原則,澳洲版「商業內幕」(Business Insider)網站簡要列出[10]這8條原則[11]對AI使用倫理進行的規範,包含:

- 有益於人類、社會和環境的福祉:在整個生命週期內,AI系統應該對人類、社會以及環境造成益處。

- 以人為本的價值觀:在整個生命週期內,AI系統應該尊重人類的權利、多樣性與個人自主性。

- 公平:在整個生命週期內,AI系統應該要是包容的(inclusive)、可取得的(accessible),且不該涉入或導致針對人類、社群或團體不公平的歧視。

- 隱私保護和安全:在整個生命週期內,AI系統應該尊重並捍衛隱私權利(privacy rights)以及資料保護(data protection)。

- 可靠性和安全性:在整個生命週期內,AI系統應該可靠地運作,並與預期目的(intended purpose)一致。

- 透明度和可解釋性:當人們受到AI系統可觀的影響時,應該要有透明且負責的公開揭露來確保人們知情,並且在AI系統與之連結時,能夠察覺。

- 可競爭性(Contestability):當AI系統可觀地影響到個人、社群、組織或環境,應該要有立即的步驟讓人們能夠質疑這個系統的使用,或是停止這個系統。

- 問責制(Accountability):AI系統不同階段生命週期的負責人應該要能夠被辨識,且必須能夠承擔AI系統的後果,亦應執行由人類監督AI系統的制度。

Karen Andrews表示[12],澳洲政府將會持續與專家合作,探索AI未來在澳洲發展的角色,與建立工具來協助AI的發展,其強調上述8條原則將鼓勵企業組織,為了澳洲而努力達到最好的結果,並以倫理最高標準來執行;她也表示這項法案是基本的,且能協助建立人民對AI技術的信任,相信AI是可靠的、安全的,且將會對人民的未來產生正面影響。

目前包括國民銀行(NATIONAL AUSTRALIA BANK,NAB)、聯邦銀行(Commonwealth Bank of Australia,CBA)、澳洲電信(Telstra)、微軟(Microsoft)及Flamingo AI等公司,均已同意加入測試這些倫理原則。

Photo created by freepik

[1] https://www.darpa.mil/attachments/AIFull.pdf

[2] 林妍溱, “微軟聊天機器人少女Tay被網友教成納粹份子,上線不到一天黯然下場,” iThome, March 25, 2016.

[3] Yilun Wang and Michal Kosinski, “Deep Neural Networks Are More Accurate than Humans at Detecting Sexual Orientation from Facial Images.,” February 15, 2017.

[4] Sam Levin, “New AI Can Work out Whether You’re Gay or Straight from a Photograph,” The Guardian, September 7, 2017, sec. Technology.

[5] 阿富汗、汶萊、茅利塔尼亞伊斯蘭共和國、蘇丹、奈及利亞北部區域、葉門、沙烏地阿拉伯、卡達、索馬利亞、伊朗。(Afghanistan, Brunei, Mauritania, Sudan, Nigeria (some northern states), Yemen, Saudi Arabia, Qatar, Somalia, Iran.)

[6] James M. Cooper, Professor of Law, California Western School of Law in San Diego.

[7] James Cooper, “Legislating an Ethical AI Approach – Taipei Times,” September 18, 2019.

[8] Brett Worthington, “Government’s Ethical Artificial Intelligence Vision a Far Cry from Terminator-Style Robots,” November 6, 2019,

[9] Science Department of Industry, “AI Ethics Framework,” Text, Department of Industry, Science, Energy and Resources (Department of Industry, Science, Energy and Resources, September 2, 2019).

[10] James Hennessy, “The Australian Government Has Released Its 8 Principles for the Ethical Use of AI – but Killer Robots Don’t Rate an Explicit Mention,” Business Insider Australia, November 7, 2019.

[11] Joseph Brookes, “Big Business to Trial Government’s AI Ethics Framework,” Which-50, November 8, 2019.

[12] “CBA, NAB and Telstra to Test Govt’s New AI Ethics Doctrine,” iTnews, November 7, 2019